身体感覚を空間に広げる「RAM」

- RAMのワークショップを拝見しましたが、モーションキャプチャーのスーツを身に着けた人の身体の動きが、人型のワイヤーフレームとしてモデリングされてリアルタイムにモニターに映し出されていました。そのワイヤーフレームは人型のままで長い棒を持った形になったり、人型の周りに透明な四角い箱が表示されたり、人型ではない形になったり、自由にモデリングできる。最初はスーツを着けた人がワイヤーフレームを動かしているのですが、やがてワイヤーフレームの形や動きに影響されて本物の人間の動きの方が変わってくる。実際にやらせていただきましたが、ダンサーがRAMを使って創作するとどうなるのかなと思いました。そもそもRAMを開発した経緯から教えてください。

-

2010年に映像を使った別のプロジェクトに参加されていた安藤洋子さんが、「自分の映り方がどんな感じになるのか試したい」と単身で来訪されたのがキッカケです。安藤さんを撮影したリアルタイム映像をモニターに流していたのですが、「モニターに映っている自分が、モニターの中にある四角いアイコンにさわれたらどうなるのかな」と言われたので、「できますよ!」と。その時、たまたまいいタイミングで時間もあったので、そこからInterLabのメンバーとの“遊び”が始まりました。

画面の中で起こっていることと現実の身体の動きが互いに影響しあうのがとても面白くて、キュレーターの阿部一直の提案で、これを活かした展示作品をつくることにしました。安藤さんはザ・フォーサイス・カンパニーの休みなどを利用して、3日から1週間ぐらいずつ3〜4回ほど来訪されました。そういうリサーチ&デベロップメントを続けて、2011年5月に発表したのが安藤洋子新作インスタレーション展「Reacting Space for Dividual Behavior」です。これはマイクロソフト社の「キネクト(KINECT)」というゲーム用の立体カメラが十数台と23台のモニターに取り囲まれたスペースで、参加者が展示空間内に入ると、立体カメラで取り込まれた身体が仮想空間内に表示されます。仮想空間内には動いたり変形したりするオブジェクトがあり、触れると音がしたり、また別の仕掛けでは動きの軌跡を描けたりできるというものです。展示のオープニングの日には安藤さんがこのシステムを使ってダンスをするデモンストレーションもありました。

展示は多くの方に喜んでもらえたのですが、それ以上にここでの経験からトライしたいアイデアがたくさん出てきてしまいました。ただ、これ以上のことを色々試すには、ある程度の安定性と精度を持ったモーションキャプチャーが必要だなあという感覚がありました。キネクトを使ったモーションキャプチャーも、展示で使ってみていたのですが、当時、少なくとも僕らが次からやりたい事にはあまり使えませんでした。それでモーションキャプチャーを取り扱っている代理店を回ったのですが、一般的に映画やゲームの制作といった業界で使われるものなので高価でとても手がでなかった。それで「自分たちでつくれないかなあ」という話になりました。 - つくれそうだと思ったのですか?

-

思いました(笑)。もちろん高級機器と同じ性能をもったものは無理ですが、自分たちが最低限必要としている性能のものならできると思いました。

市販されているモーションキャプチャーの多くは、基本的にきちんとしたセットアップと専用のスーツなどを使って精度の高い膨大な量の動きのデータを採取することが可能です。ただ、そこまで高機能でなくてもやれることはかなりあるだろうという予想があったのと、成果のオープンソース化も前提で考えて始めていましたから、必要なツールがある程度安価で手に入るといいなとも考えました。そこで自分たちが必要なだけの身体の動きのデータを取得できるものを、できるだけ安価でつくろうと思い、スマートフォンにも入っている慣性センサーを使うことにしました。必要な部位に慣性センサーを取り付け、そこからの値を人の身体のモデルに当てはめれば、コンピュータ内で人の動きとしてモデリングできるのではないかと考えました。ただし、この仕組みだと体の姿勢データはある程度取得することができますが、空間中の位置、たとえばダンサーが舞台上のどこにいるかは計測できません。また、同じ理由で体全体が上下に移動していることなども測定されていないので、ジャンプしても画面上では反映されないなど、いくつか制限はあります。それで、2012年3月から13年2月まで約1年かけて研究開発を行い、他のソフトウェアツールキットなどと一緒に公開しました。

非常に高価なハイエンドのモーションキャプチャーも協賛で数回貸してもらい、それでしかできない実験も行いました。光学式というタイプのもので、10台以上のカメラをダンスエリアの外側に設置して使用しました。マーカーと呼ばれる小さな白球を体に貼り付け、それを使ってミリ単位で位置や姿勢の計測ができます。専用のスーツを着ると、その見た目や着心地からダンサーが踊る時にストレスを感じるなどの問題はありましたが、反応速度も非常に優秀だったので、僕にとっては楽しい作業でした。

2012年の夏頃に、そのモーションキャプチャーのマーカーを取り付けた2つの棒を使って踊るテストをしたことがあります。スクリーン内では2つの棒がカーブで繋がるように、ベジエ曲線を表示しました。当時ザ・フォーサイス・カンパニーに所属していた島地保武さんがその棒を両手に持って、モニターに表示されている曲線を見ながら踊ったのですが、コンピュータを操作して曲線の堅さを変化させると現実の身体の動きが変わったんです。視覚からのフィードバックで、自然に「縄跳びの縄のような柔らかい縄を持っている感覚の動き」「竹ひごのような硬いけど曲がる棒を持っている感覚の動き」というように動いている人の感覚や、動きそのものに違いが生まれる。それをみて「センサーとリアルタイムのヴィジュアルフィードバックをうまく使って色々と面白いことができるかもしれない」と思いました。

そういうカーブを表示したりするような環境を、僕らはその後「シーン」と呼ぶことになるのですが、その時点ではどういう環境だったら身体の動きと連動して面白くなるかわからなかったので、メンバーが思いつくままにたくさんつくって、そこから安藤さんと一緒にブラッシュアップしていきました。現在までにワークショップなども含めてかなり多くのシーンをつくりましたが、興味深いのは、RAMである程度体験したシーンは、システムがなくても後から「感覚として思い出して使う」ことができるんです。何か体験したことや訓練したことを、人が体で覚えていたりするというのと基本的には同じだと思いますが、僕たちは「書いたソフトを人の頭にインストールする」と言って盛り上がりました。これは僕らにとって新しい感覚の発見でした。 - なるほど。RAMによって視覚から脳に入った情報が、体験による知覚と同等になるということですよね。ちなみに、以前のインタビューで、安藤さんが「RAMによって自分の頭の中にあるイメージを他のダンサーと共有できる」とおっしゃっていましたが、それはどういうことでしょうか。

- ザ・フォーサイス・カンパニーでは、即興の練習をする時に、例えば「自分の両手の先から線が延びている。今日は2メートル」というように設定を決めているのだそうです。線の長さだけでなく、質感とか、張りとか、そういった細かな条件も時間をかけて打ち合わせしながら設定し、設定についてのイメージが同じになるように何度も練習して、それから即興をはじめる。でもRAMを使えば、設定する線の長さや質感を視覚的に確認できるので、モニター上では2人ともほぼ同じイメージを持って動くことができるわけです。それが「自分の頭の中にあるイメージを他のダンサーと共有できる」という意味です。その根底にあるのが、安藤さんがザ・フォーサイス・カンパニーで培ってきた「個人のダンサーでありながら、集団でもあり得る、そしてそれぞれのダンサー(エージェント)が独立したダンスをしていながら、同時に他のダンサーたちと同期している」という即興のダンスに対する考え方です。

- 今日もそうでしたが、こうしたワークショップなどRAMを普及する催しがいろいろと行われています。

- その中のひとつが、ダンサーとプログラマーにチームを組んでもらってRAMを試してもらうワークショップです。2013年2月にRAMの開発成果を発表するプレゼンテーションを行ったのですが、その際、ダンサーとプログラマーにチームを組んでもらって3日間で新しい「シーン」を作るワークショップを行いました。参加者はあわせて35人位だった思います。ダンサーもプログラマーも全国から色々な人が集まりました。プログラマーは学生から有名ゲーム会社の社員までさまざまでした。RAMや身体に対する関心の持ち方がそれぞれ異なっていたので多様なシーンができてとても面白かったです。コンピュータに興味のあるダンサーでもプログラマーと出会う機会自体があまりないので、その意味でもとても好評でした。

- こういうアーティストとメディア・テクノロジーの出会いの場を提供するのもYCAMの役割ということですね。必要とされているのに、どこもやっていない重要な取り組みだと思います。

- 私たちもそれは感じていて、2014年にもダンサーとプログラマーを対象にした3日間の集中コースを「RAMサマーキャンプ」という名前で開催しました。13年と同じようにチームでの創作を中心にしながら、平行してさまざまなレクチャーやワークショップを行いました (*1) 。盛り沢山のプログラムでしたが、こうしたレクチャーによって、これまでの歴史的背景、お互いが具体的にどのようなことをしているのか、そして今後の可能性などを理解しておくことによって、共同作業から参加者が得られるものを豊かにできたと考えています。

- RAMを使ってダンス作品を創作したことがありますか。

-

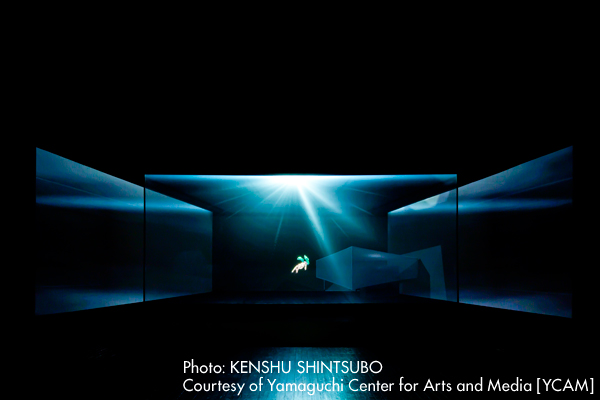

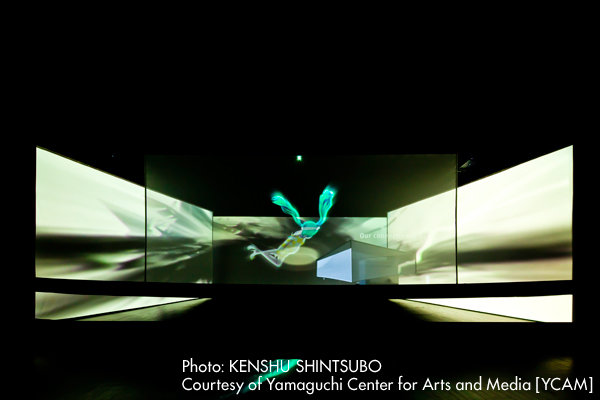

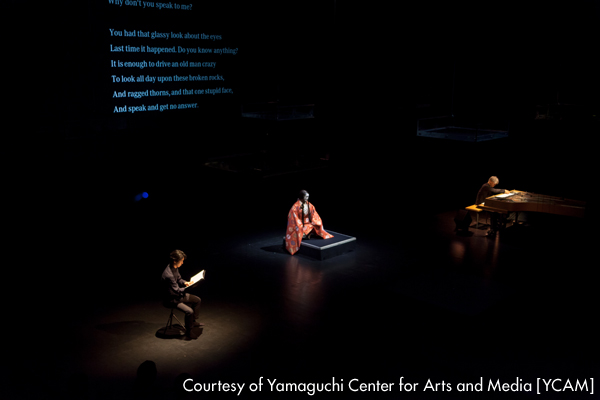

はい。一度は作品をつくるところまでやらないとRAMの課題が明らかにならないと思ったので、2015年1月に『DividualPlays─身体の無意識とシステムとの対話』というパフォーマンス作品を発表しました。安藤さん、元ネザーランド・ダンス・シアターの小㞍健太さん、ベルリンを拠点に活躍している川口ゆいさん、ニューヨークでキャリアを積んで山口に戻って来ていた笹本龍史さんに出ていただきました。空間デザインには建築家の田根剛さんに参加してもらいました。

これまでRAMでつくってきたシーンは、主にスクリーンにビジュアルとして映されることでダンサーに伝えていました。今回はそれだけではなく、小さな装置のような物理的に動く仕掛けを沢山つくって、シーンとして使うことを新たに試みました。私たちは「箱庭」と呼んでいましたが、ダンサーがその仮想空間で動くのと連動して装置内のモーターが回転したり、ファンが回って水蒸気が舞い上がったりします。ダンサーはステージ四方に配置されたモニターで、シーンや箱庭の様子を見ることができます。観客席からはダンサーと連動する装置の動き、スクリーンに映されたシーンの映像が見えていました。 - 仮想空間の認識がないと、観客には「ダンサーと動く小物達」というだけの舞台に映るかもしれませんね。といって事前に説明されるとパフォーマンスが「答え合わせ」になってしまいそうですし。

- そこがまさに課題でした。本当は観客全員がRAMのシステムやこの公演用の装置を体験した上でパフォーマンスを見られればいいのですが、そうもいかない。ポストトークなどで解説はしましたが、伝えるのは難しかったです。創作する時にダンスの動きを見つけるためだけにシステムを使用し、本番ではセンサーを装着しないで公演を行うという選択肢もありましたが、それは自分たちが最もトライしたいことではないですし。真正面から挑んだので、苦しかったですね。

- 自分たちでハードルを上げていますよね(笑)。ただこれは、相当にいろんな可能性に指を掛けていると思います。

-

そうなんです。400メートルハードル日本記録保持者の為末大さんに来ていただいてアスリートへの応用についてアドバイスして頂いたりもしました。まだこれからですが、障がい者と関わる企画の提案なども頂いています。色々な可能性があって、広がりは大きいと思います。

ごくシンプルに言ってしまうと、RAMが注目しているポイントは、「情報と身体とのフィードバックの中で、身体の形や動きがつくり出されていく」ということです。それを探求し、応用するためのシステムがRAMだと考えています。 - RAMのソフトウェアはオープンソースとしてネット上に公開されています。知的財産権を主張しないのですか。

- シーンをデザインするためのツール、モーションキャプチャーのシステムのつくり方、僕たちがつくったアプリケーションをすべて公開しているので、誰でもダウンロードして使うことができます。特別な環境がなくても、基本的にフリーのソフトだけを使ってコードを書き直すこともできます。これが完成形ではないので、できるだけ多くの人に使ってもらって結果をフィードバックしてもらえればと思っています。クローズドするよりも、公開できるものは適切なライセンスを使って公開した方が我々にとってもプラスが大きいんじゃないか、と判断しました。そもそも私たちも多くのオープンソースのプロジェクトを利用してつくっていますし。

- RAMの開発体制について教えてください。

-

YCAM InterLab としては、基本的に私がソフトウェアなどの開発サイド、映像エンジニアでダンサーでもある大脇理智(コラム参照)

がプロダクト部分のデザインなどをまとめながら、プロデューサーの竹下暁子をはじめとする沢山のメンバーと一緒に進めてきましたk。また、センサーを担当した大西義人、プログラマーでありアーティストの比嘉了やカイル・マクドナルドなど、外部の専門家たちとかなり根っこの部分から一緒になってアイデアを出しあって開発してきました。

YCAMとInterLabについて

- YCAMは、日本のメディアアートの創生期に「公立の文化施設としてメディアアートの拠点を」という理想があって構想された施設です。

- 山口市の情報文化都市基本計画というのがあって、いまYCAMがある辺りにIT関係の企業を誘致する計画があり、そういった職員達の共同利便施設としてここに何かを整備するという計画があったのが始まりのようです。そこから、それを文化施設にしようという話になり、メディアアート施設へと進展していったようです。開館当時は設立に反対意見なども多く大変な時期もあったのですが、多くの方の尽力のおかげで今の形になってきています。

- YCAM InterLabのメンバーはどのようになっていますか。

- 昨年度までは、私、大脇、デジタルファブリケーションから舞台、展示の仕切りまで色々やっている岩田拓朗、スケジュールや予算管理といったプロダクション・マネージャーのクラレンス・ン・キアン・ピアオ、照明エンジニアで地域系リサーチが得意な高原文江、音響エンジニア兼プログラマーの中上淳二、サーバー・ネットワーク・エンジニア兼プログラマーの三浦陽平、グラフィックデザイナーの伊勢尚生、映像と電子工作の今野恵菜という、どちらかというとYCAMの技術部分を担う9人がYCAM InterLabのメンバーでした。しかし、2015年4月から総務部門以外の全員をInterLabと呼ぶことになりました。そもそもこれまでもテクニカルチームだけで何かをしてきたわけではなく、アイデアを形にするためにYCAMの様々な専門性を持つスタッフが関わって取り組んできているので、これは自然な流れだと思っています。

- テクニカルの専門集団としてのInterLabは当初から構想されていたものなのですか。

- 当初のスタッフでメディアアートが良くわかっているプロのエンジニアと呼べたのは山元史朗(現在はフリー)だけだったと思います。あとは照明、音響、舞台など、劇場を運営するために必要な技術スタッフを揃えたという感じで、私も劇場の音響チーフとして入りました。岐阜県立国際情報科学芸術アカデミー(IAMAS)を卒業したばかりで劇場経験が全くなかったので、東京の劇場に3週間研修に行って必死に学びました。

- YCAMのオープニングは、フィリップ・ドゥクフレの『イリス』でした。僕も見に来ましたが、あの舞台をそんな若者達が支えていたとは驚きました(笑)。IAMASはメディアアートのアーティストを多数輩出していることで知られていて、YCAMの職員にはIAMAS出身者が多いと聞いています。

- 山元さんもIAMASの助手でしたし、中上もIAMAS出身です。YCAM全体では現在でもIAMAS出身のスタッフが4人います。IAMASは学生に対する教諭の割合が高く、アーティスト・イン・レジデンスにも積極的で、海外のアーティストが滞在して学生とプロジェクトを行ったりしていました。学校は24時間出入りすることができて、遊ぶ場所がほとんどない立地だったのでみんなずっと学校にいて、大きな家族みたいな印象でした。僕は6期生で、サウンドとプログラミングを専攻していましたが、学生もみなバックグラウンドが全然違って、18歳から60歳代の方までいて刺激的でしたね。出身者にはライゾマティクスの真鍋大度や石橋素、アーティストの高嶺格、桑久保亮太、山城大督、三原聡一郎などがいます。

- RAM以外にもメディア・テクノロジーを応用した実験的な作品づくりを行っています。2010年以降に滞在創作した国内アーティストだけみても、コンテンポラリーダンスの 梅田宏明 、白井剛、 contact Gonzo 、ミュージシャンの池田亮司、坂本龍一、蓮沼執太、アーティストの高谷史郎、 高嶺格 、真鍋大度、梅田哲也、ライゾマティクス、演劇の 岡田利規 など錚錚たる顔ぶれです。当初からそうした方針はあったのですか。

- 当初からアーティスト・イン・レジデンスは事業の柱になっていて、ダンス作品『イリス』の制作ではフィリップ・ドゥクフレのチームがかなり長期滞在していました。ただInterLabがアーティストとの共同創作に大きく関わるようになったのは『PATH』(2004年)からですね。YCAMの立ち上げからお世話になっているダムタイプの照明家・ 藤本隆行 さん、真鍋さんと古堅真彦さん、音楽家の内橋和久さん、歌手のUAさん、そして僕らが加わってサラウンドをコントロールする新しい演奏ツールやそれに連動して動く照明のシステム等を開発しました。内橋さんがペンで画面に線を描くと、その軌道の通りに音(UAの声)が空間を移動する。その時は天井から23個のスピーカー、巨大なスクリーンを吊り下げ、沢山のLED照明を設置しました。サラウンドの装置はペンタブレットでつくられていて、入力するペンの押し加減で音を制御できたり、楽器として即興でサラウンドミックスができるなど色々な機能をつくりました。入出力が6チャンネルあり、一画面で6つの音が同時に駆け回り、その音に応じて光や映像も変化しました。サラウンドのソフトウェアは、いまでも内橋さんがツアーで使ってくれています。

- 2007年には霧と映像を連動させた『LIFE』を発表しました。

- 『LIFE – fluid, invisible, inaudible…』は音楽家の坂本龍一さんとダムタイプの高谷史郎さんによるインスタレーション作品で、水槽の中の霧に映像を映し出すものです。霧が消えるとフワーッと絵が霧散し、霧が入ってくるとゆっくり絵が現れる。サウンドとも連動した霧と映像を制御するシステムを、InterLabがアーティストでありプログラマーの古舘健さんや真鍋さんと担当しました。この他、筋電センサーとLEDを連動させた藤本さんとダンサーの白井剛さんたちの『true/本当のこと』(2009)も一部ですがお手伝いしています。梅田宏明さんの『Holistic Strata』(2011)は我々が本格的に取り組んだ作品のひとつです。また、開館10周年記念には坂本龍一さんと『FOREST SYMPHONY』というインスタレーションに取り組みました。樹木を流れる微弱な生体電位を独自のセンサーを使って採取し、世界8カ所から毎日送られてくるデータを使って、YCAMの展示会場でシンフォニーをつくりました。。

- コラボレーションするアーティストはどうやって決めているのですか。

- 多くのプロジェクトでアーティストを始め、テクノロジストや研究者とコラボレーションをしています。今は韓国のアーティスト、ムン・キョンウォンさんを迎え、3年かけてリサーチ&デベロップメントを続けた「プロミス・パーク・プロジェクト」 (*2) の集大成となる展覧会を製作中です。今回もムンさん以外にも多くのコラボレーターに参加してもらっています。こうしたアーティストをどのように決めているかは、InterLabメンバーがリサーチをして意中の人を提案するほか、アーティストからの企画提案を受けることもあります。大規模なものは大体1年〜1年半ぐらい前から準備を始めて、プロジェクトに関わる中心的なメンバーでブレインストーミングを繰り返し、できることを考えて開発をはじめることが多かったです。滞在期間はケースバイケースですが、1回あたり1日〜数日程度の滞在を複数回重ねます。そうして試しながら骨骼をつくり、最後の1週間から1カ月程度で実際の展示スペースを使って一気に仕上げることが多いです。

- これからのYCAMの展望について教えてください。

-

開館10周年がこれからの方向性をみんなで考える機会になったように思います。アート表現や教育を柱として継続しながら、もうちょっと幅広く、地域や各分野の研究者といった多様なインプット、アウトプットを試してみたいということになりました。たとえば今年企画した『Think Things─「もの」と「あそび」の生態系』という参加型展覧会では、我々のものづくりのプロセスの基本的な考え方を使って、子どもたちにYCAMで開発した装置やソフトウェアなどのプラットフォームを開き、クリエイションに参加してもらう場づくりを提案しました。

僕たちは「技術」自体を特別視してなくて、他のアイデアと同じく、選択肢を広げるものだと思っています。YCAMが得意とするところは芸術や教育に技術や考え方を応用する部分です。技術からインスピレーションを得ることは多いですが、それ自体を使うことが目的なのではなく、「それをやるなら、これを組み合わせたらもっと面白くなるよ」というところでアイデアを考えることが多い。様々な研究をアート等に当てはめてみて、僕らで手が足らなければ外部のアーティスト、テクノロジストなど専門家とのネットワークもどんどん投入し、最終的に良いものをつくって人に見せるのが僕らの仕事です。応用の応用みたいな立ち位置ですが、それを自然体でやれるのがYCAMという場だと思っています。 -

研究とアーティストの両方を理解して繋げられる専門性とセンスを持って「こうすればもっと面白くなる」という提案ができるところがYCAM InterLabの存在意義だというのがよくわかりました。長時間のインタビューをどうもありがとうございました。

大脇理智(YCAM映像エンジニア/メディアトゥルグ)

- 大脇さんの専門をうかがえますか。

- 専門は映像エンジニアですが、自分も踊りますし、表現者なので技術者との間に入って説明するという意味で「メディアトゥルグ」と名乗っています。初期のInterLabはアーティストと技術の接続部分を担ってきました。RAMで言うと、ダンサーとプログラマーの接点をやりました。さらにすごく具体的にはアーティストが表現したい映像を効果的に投影するプロジェクターの使い方を提案するとかもやります。両方のことをわかっているのでその技術的なプラグを担うことが多かったです。そこから次第にアーティストの中でもまだ形になってないアイデア部分から関わるようになっていきました。

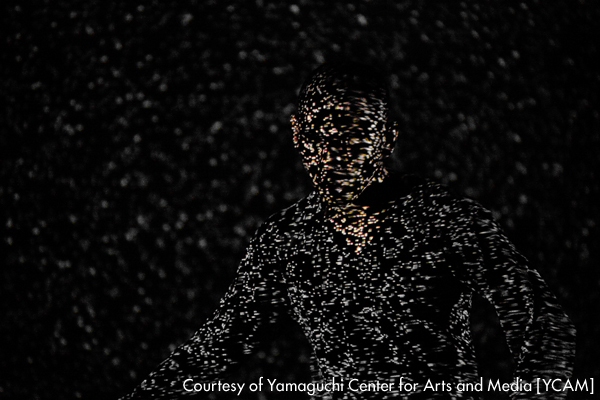

- YCAMが本格的に関わったダンス作品では 梅田さん の代表作『Holistic Strata』があります。梅田さんはいま最も海外に招かれて公演をしているダンサーの一人です。センサーを装着した彼の身体の動きと映像の点(ピクセル)がリアルタイムに連動し、ピクセルが粒子群となって雨や竜巻のように動き回る非常に美しい作品でした。

- 最初の1週間はぶっ続けで音響テスト、照明テストをしていました。梅田さんが技術に詳しくてオペレーションできる人なので、プログラマーを集めてディスカッションしながらコンセプトづくりから参加しました。最初は「錯視」がテーマだったので錯視的な照明とは?錯視的な音とは?と試行錯誤し、錯視の専門家へのヒアリングも行いました。彼は機材のオペレーターを自分でやります。音と映像を流すボタンを押してから舞台に出てひとりでパフォーマンスするスタイルなので、開発段階からプログラマーと直接ディスカッションすることが必要でした。

- RAMもそうですが、舞台上でリアルタイムに様々な情報をフィードバックさせていく作品が多いように思えます。

- ちょうど10年ぐらい前からコンピュータの能力が向上して、やっとそういう使い方ができるようになりました。かつてビデオアートと言えば、収録した音や映像を再生することがメインでした。たとえば『FOREST SYMPHONY』を10年前にやろうとしたら、その収録データを持って帰ってから音に変換し、そのままプレーヤーでスピーカーから鳴らしていたでしょうね。

- RAMのようなセンサーを使ったインタラクティブなダンス作品としては、アンジェラン・プレルジョカージュ『ヘリコプター』やチャンキー・ムーブ『glow』などいろいろあります。しかし、こうした作品には技術のプロモーションになってしまう危険が常に潜んでいますよね。

-

もちろん私たちは面白い作品にしたいと思って取り組んでいますが、バランスがうまくいくかどうかは正直やってみないとわからない。一般的に「物」をデザインする人と、パフォーマンスやイベントのような「事」をデザインする人がいるとすると。先に「物」をつくったら、それを使ったパフォーマンスを後から考えるしかない。「事」を先につくれば必要な「物」を後から用意することになる。従来はそうした「事」か「物」か、どちらかに足場を固めてからつくる必要がありました。そうではなく、「事」や「物」が常に入れ替わり、変化させられるようにできないか、というのがRAMのベースにある考え方です。こうした考え方はRAMに限ったことではなく、例えば遊びでもビデオゲームのように与えられたルールの中で勝敗を決めるのではなく、遊びながらどんどんルールが変化してもいいような「物」と「事」の関係を流動的にすることを考えていて、参加型展示「Think Things」でも試みています。

僕はYCAMがやっているのは、「技術に対する批評」だと考えています。例えばメディアアートの映像がディスプレイ内で完結していたら映画と変わらない。「カメラで記録するとはどういうことか」「ディスプレイという環境とはどういうものか」という疑問と批評性が含まれているのがメディアアートの基本姿勢です。YCAMはその拠点として、音や照明も含め、技術に対する批評性、もっといえば作品や地域といったものに対する批評性を持っているべきだと思います。そのためには幅広い議論を行い、オープンなものづくりをすることが前提として必要だと思っています。

2003年開館。山口市中央図書館を併設した複合文化施設。YCAMの施設には、演劇・ダンスなどの公演に適したスタジオA(可動客席数450)、展示スペースにもなるスタジオB(フリースペース)、映像上映に適したスタジオC(スクリーン有、客席数100)、創作・学習室などがある。「Research & Development Project」によりさまざまな事業を展開。メディア・テクノロジーを応用したオリジナル作品の創造、メディア・テクノロジーと市民を繋ぐ教育プログラムの開発・提供、地域への還元を行っている。メディア・テクノロジーに長けたエンジニアを含むYCAMインターラボ(YCAM InerLab)と呼ばれる開発チームが外部のアーティストなどとともに事業を実施しているのが特徴。

https://www.ycam.jp/